米国のDXとメガコンステレーション構想(3)新規ビジネスを生み出す宇宙行政

宇宙にある衛星のトラフィック量を管理する行政部門の設置を米国商務省が提案している。ここに新規ビジネスの可能性がある。不用になった衛星の回収サービスである。日本も衛星回収を考えているようだが、ビジネスとしては未だ捉えていない。日本がビジネスとして捉えれば日米のコラボレーションがここでもありうる可能性が出てきた。 (セミコンポータル編集室) [→続きを読む]

» 寄稿 » 寄稿(半導体応用)

宇宙にある衛星のトラフィック量を管理する行政部門の設置を米国商務省が提案している。ここに新規ビジネスの可能性がある。不用になった衛星の回収サービスである。日本も衛星回収を考えているようだが、ビジネスとしては未だ捉えていない。日本がビジネスとして捉えれば日米のコラボレーションがここでもありうる可能性が出てきた。 (セミコンポータル編集室) [→続きを読む]

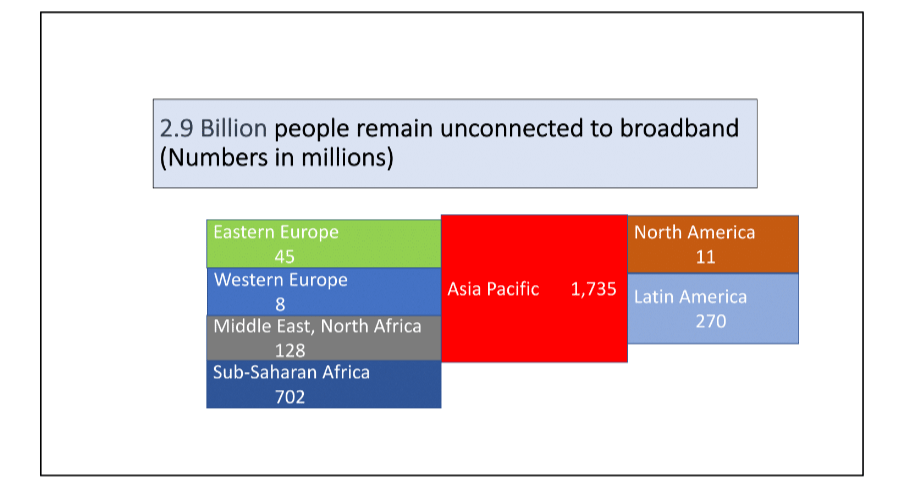

メガコンステレーションは、膨大な数の通信衛星を結んで高速のインターネットサービスを提供する構想である。地上の光ファイバでカバーできない地域を補うためのサービスでもある。通信衛星はすでに混雑状態にある。通信衛星同士が衝突したという事故も出てきている。通信衛星の混雑ぶりを前川氏とR. Shield氏が紹介する。 (セミコンポータル編集室) [→続きを読む]

2020年3月から連載形式で、米国ワシントンDC在住のAEC/APC Japanのアドバイザである前川耕司氏に、米国におけるデジタルトランスフォーメーション(DX)について寄稿をいただいた(参考資料1)。今回の寄稿は、その続編ともいうべき衛星通信を用いたインターネット接続のメガコンステレーション構想である。 (セミコンポータル編集室) [→続きを読む]

新型コロナウィルスに関する報道はかなり減ってきた。これまでの間にさまざまなことがわかってきたからである。以前と同じ様式ではまたコロナが拡大してしまうため、マスクや物理的に人と離れるなどの対策をとることを前提で仕事に取り組む。また半導体・ITは特需ともいえるほどクラウド需要が高い。最新の動きを紹介する。(セミコンポータル編集室)

[→続きを読む]

前川耕司氏の寄稿による連載「姿を現しつつある米国のDX」シリーズ第2部の第4回では、IoM(Internet of Manufacturing)に関するカンファレンスの中から、予知保全をはじめとして、設計と製造の最適化、さらにITとOT(Operation Technology)の共同作業によるスキルの持ち方について述べている。(セミコンポータル編集室) [→続きを読む]

前川耕司氏の寄稿による連載「姿を現しつつある米国のDX」シリーズ第2部の第3回では、IoM(Internet of Manufacturing)に関するカンファレンスから、製造業においてIoTシステムを使った生産性の向上、総合設備効率の向上などを紹介する。エッジコンピューティングが中心だが、リモートアクセスできるクラウド利用も進みそうだ。(セミコンポータル編集室) [→続きを読む]

前川耕司氏の寄稿による連載「姿を現しつつある米国のDX」シリーズ第2部の第2回では、IoM(Internet of Manufacturing)に関するカンファレンスの中から具体的な講演内容をレポートする。スマートファブで予知保全に取り組み、実績を上げているSchneider社の事例を紹介している。(セミコンポータル編集室) [→続きを読む]

AEC/APC Symposium Japanの前川耕司氏が米国におけるデジタルトランスフォーメーション(DX)事情について、第1部では次世代通信技術5Gについてレポートした。今回から始まる第2部では、IoM(Internet of Manufacturing)とIndustry 4.0について議論する。その第1回はIoMに関するカンファレンスからレポートする。(セミコンポータル編集室) [→続きを読む]

米SIA(半導体工業会)がトランプ大統領の入国管理宣言に対して反対意見を述べ、各地の大学や研究ではAIを使ったワクチンの開発にいそしみ、IT業界は感染経路の可視化に力を入れている。こういった世界の研究所、大学などが新型コロナウィルスの撲滅に力を注いでいる。欧米、アジアでの取り組みについてレポートする。(セミコンポータル編集室)

[→続きを読む]

海外の研究機関は、新型コロナウイルスにどう対処しているのだろうか。半導体業界を中心に新型コロナが市場へ及ぼす影響や、それらを退治するための研究手法、新型コロナを鎮めるための国家プロジェクト。さまざまな取り組みが世界各地で行われている。4月中旬に発表された、これらの取り組みを以下、要約という形で紹介する。詳細は各情報に記述したURLをアクセスしていただきたい。(セミコンポータル編集室)

[→続きを読む]